深潜实验室:揭秘蚂蚁灵波如何用“四连发”重构机器人大脑

深夜,实验室的灯光依旧明亮,屏幕上跳动的数据流仿佛是机器人初生的脉搏。对于很多深耕具身智能的工程师而言,这周注定是不平凡的。蚂蚁灵波科技就像一位不按常理出牌的破局者,短短七天内,连续抛出四枚重磅炸弹——四款具身智能大模型接连开源。这不仅仅是代码的释放,更像是给那些在物理世界中“笨拙”行走的机器人,装上了一颗能够感知、推演、行动的“超级心脏”。

第一阶段:打破感知的迷雾

想象一下,如果机器人连透明的玻璃杯都看不见,又谈何服务人类?灵波科技的第一步,便是与奥比中光联手,推出了LingBot-Depth。这个高精度空间感知模型,就像是给机器人戴上了一副高科技眼镜,让它在面对反光、透明物体时,不再像无头苍蝇般乱撞。它解决了视觉上的“近视”,让物理世界的抓取变得精准无比。

第二阶段:构建世界的推演引擎

解决了“看”的问题,下一步就是“想”。LingBot-World和LingBot-VA的出现,标志着机器人开始学会“脑补”未来。尤其是LingBot-VA,它不再是简单的指令执行者,而是学会了“边推演、边行动”。这种自回归视频-动作建模框架,让机器人像老练的棋手,在落子前已经预判了局势的走向,极大地提升了决策的流畅度。

第三阶段:打造通用的智能基座

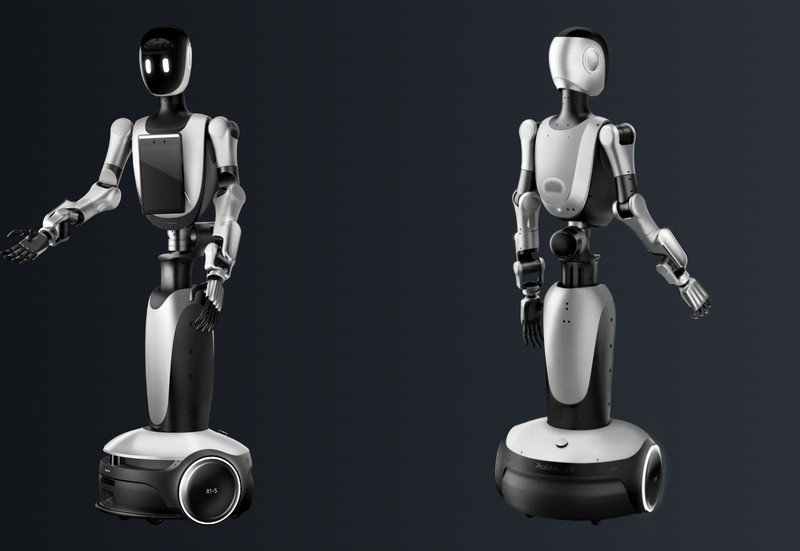

真正的野心,在于LingBot-VLA。它不仅仅是一个模型,更是一个跨本体、跨任务的基座。这意味着,无论你是人形机器人还是轮式机器人,只要接上这个“大脑”,就能快速获得泛化能力。开发者们不再需要为每一款硬件重写逻辑,这一举动极大地降低了商业化落地的门槛。

执行要点与进阶策略

对于想要入局的开发者而言,这次开源不仅仅是拿来即用,更是一次深入底层逻辑的机会。建议优先从数据处理库入手,利用蚂蚁开放的全套工具链进行微调。进阶策略上,应重点关注多模态数据的融合训练,通过LingBot-World构建的高保真虚拟环境,先在数字世界中完成百万次仿真训练,再迁移至物理实体,这样能有效规避实机损耗带来的高昂成本。

常见问题与落地避坑

许多团队常犯的错误是过度依赖单一模型,而忽略了模型与硬件的适配性。务必记住,开源模型只是基础,真正的核心竞争力在于你针对特定场景(如工业分拣或家庭服务)所做的微调数据。如果遇到评估指标不理想的情况,请检查自动化评估代码库,确保训练数据与实际物理环境的分布一致。